De nos smartphones aux ordinateurs en passant par les poubelles intelligentes, l’IA est partout et on en parle tous les jours. Mais qui sont les génies qui ont imaginé tout ça ?

Nous sommes bien loin de l’époque où l’IA était réservée à la science-fiction et éveillait la crainte de presque tout le monde, à part les spécialistes. Aujourd’hui, elle est partout dans notre vie quotidienne. On l’utilise presque tous les jours, soit dans nos smartphones, soit sur nos ordinateurs. C’est une technologie impressionnante qui n’est encore qu’à un nveau moyen de son évolution. Mais connaissez-vous les génies qui ont posé le sou bassement de cette grande révolution ? De la théorie à l’usage concret, voici certains des plus grands artisans de l’humanité.

Dans cet article :

Les précurseurs de l’IA : d’une vague idée à la théorie concrète

L’histoire de l’IA n’est pas liée à la création de l’ordinateur. Plus concrètement, ce n’est pas la création de la machine informatique qui a suscité l’idée de l’IA. Elle a déjà pris ses racines bien avant que cette dernière ne soit créée. Et c’est à Isaac Asimov que nous devons l’idée, puisque c’est lui qui, en 1940, dans ses œuvres de fiction, imagine des machines dotées d’un cerveau artificiel.

En 1943, les scientifiques Warren McCulloch et Walter Pitts parviennent à mettre au point le premier neurone artificiel en s’inspirant des cellules cérébrales. C’est le point de départ des réseaux de neurones qui constituent aujourd’hui un pilier fondamental de l’IA.

L’intelligence artificielle : une discipline qui prend corps et s’élargit

Des travaux scientifiques commencent pour tenter de matérialiser ce nouveau concept. Dans ce cadre, il est important de mentionner Alan Turing, le prodige anglais qui, en 1950, parle d’une machine capable d’apprendre par elle-même dans son article ‘‘Computing Machinery and Intelligence’’. Il va joindre la parole à l’acte en 1952 avec Turochamp. Ce programme avait la possibilité de jouer aux échecs en apprenant quelques stratégies du jeu.

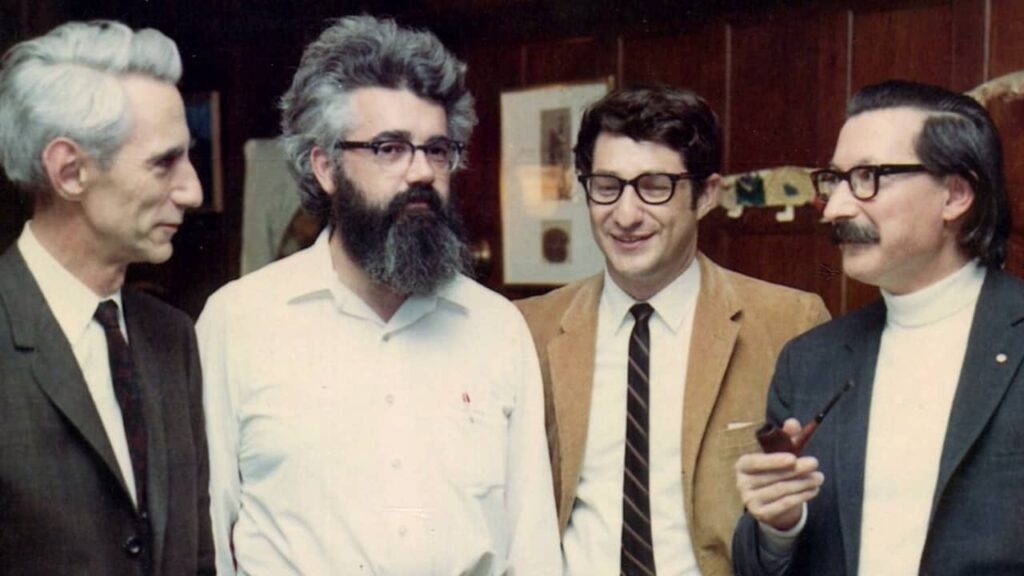

Des idées de génie émergent les unes après les autres. Un domaine se dessine et il fallait lui donner clairement forme. C’est à ce propos qu’est organisée en 1956 la Conférence de Dartmouth. C’est là que nait l’expression « intelligence artificielle ». Elle est utilisée pour la première fois par John McCarthy, créateur du langage de programme LISP. Depuis cette conférence, l’intelligence artificielle est devenue une discipline scientifique en elle-même et n’est plus assimilée à une autre.

Un an après cette conférence historique, 1957, Frank Rosenblatt dévoile le Perceptron : réseau combinant plusieurs neurones artificiels. C’est une étape décisive dans le domaine, puisque cela donne au cerveau artificiel la capacité d’apprendre par l’exemple.

Près de 6 ans après les élucubrations d’Alan Turing, le machine learning trouve une application réelle avec Arthur Samuel en 1959. Il parvint à développer le premier programme de jeu de dames capable d’apprendre par lui-même. Il théorise ainsi le machine learning auquel il donna une définition bien explicite : « sous-discipline de l’informatique permettant aux ordinateurs d’apprendre sans être explicitement programmés ». Une avancée prometteuse qui sera malheureusement suivie des décennies de disettes dans le domaine.

VOIR AUSSI : Deep Blue vs Kasparov : la machine a-t-elle vraiment été supérieure à l’humain ?

La révolution du deep learning qui relance tout

De 1960 à la fin des années 80, l’IA semble endormie. Plus aucun résultat jusqu’à ce qu’on entre dans la dernière décennie du XXe siècle et le deep learning apparu pour relancer la partie. Ce que l’on désigne encore par l’apprentissage profond s’inspire de la constitution du cerveau humain pour développer des réseaux de neurones avec plusieurs couches. En conséquence, le cerveau artificiel n’est plus cantonné à une seule tâche, mais à plusieurs, car chaque niveau de son réseau de neurones peut se focaliser sur un traitement spécifique. L’IA pouvait alors apprendre plus et mieux.

Au nombre des précurseurs de cette avancée majeure, il y a l’actuel directeur scientifique de l’IA chez Meta, le français Yann LeCun. Il est notamment connu pour avoir développé LeNet, un réseau neuronal qui pouvait reconnaitre les caractères manuscrits sur les chèques bancaires.

Le deep learning a été une étape décisive pour l’IA. De nombreuses sociétés de recherche, dont Google, vont l’utiliser pour créer et le vulgariser. La société met au pied son équipe de recherche, Google Brain. Cette dernière avait pour mission de mener des recherches sur le deep learning et l’IA. Mais en 2012, le domaine va encore faire une percée énorme avec le réseau AlexNet, développé par Alex Krizhevsky, Ilya Sutskever et Geoffrey Hinton. Dans le cadre de la compétition de reconnaissance d’images, ImageNet, le programme du trio bat tous ses concurrents dans la reconnaissance d’image. Ceci a eu pour effet de dévoiler tout le potentiel du deep learning.

Ce potentiel sera alors repris et va servir à développer plusieurs programmes phares, dont les assistants vocaux Google Assistant, Alexa, etc. Facebook et Google vont aussi exploiter ce potentiel pour la reconnaissance d’image. Netflix et autres sociétés l’exploitent pour la recommandation de contenus. Si vous l’ignoriez, le deep learning a permis la mise au point des filtres photo et de la reconnaissance faciale qui équipait depuis longtemps vos smartphones.

Des Transformers à l’IA générative, il n’y a que l’attention

Le deep learning classique, il avait la possibilité d’aider à classifier et à reconnaitre, mais pas de générer. L’IA semble être cantonnée à ce niveau jusqu’à ce qu’une équipe de recherche chez Google, Vaswani et al, publie en 2017 un article intitulé ‘‘Attention is All You Need’’. Leur grande nouveauté était le mécanisme d’attention : une façon de traiter l’information qui permet au modèle de se concentrer sur les parties importantes des données d’entrée, sans avoir besoin d’un traitement séquentiel lourd.

Cette architecture révolutionne encore l’IA et ouvre la voie à l’IA générative qui est omniprésente dans nos vies aujourd’hui. Les Transformers ont donc permis la génération de texte (GPT-2, GPT-3, GPT-4, Gemini, Claude), la génération d’image (DALL-E, Stabe Diffusion, Imagen 3), la génération d’audio, de vidéo, etc.

Si tout le monde s’enthousiasme du potentiel énorme de cette technologie, il faut aussi reconnaitre les inquiétudes liées à son revers. Elle a déjà commencé à révolutionner nos vies, mais sommes-nous prêts pour tout ce qui arrive ?

BuzzWebzine est un média indépendant. Soutiens-nous en nous ajoutant à tes favoris sur Google Actualités :