Des intelligences artificielles destinées à des utilisations psychiatriques, cela existe déjà à l’heure actuelle. Mais ces algorithmes, aussi neutres et infatigables sont-elles, pourraient-elles un jour remplacer le psychiatre humain ?

Il existe aujourd’hui plus d’une vingtaine d’intelligences artificielles ayant été validées par des études pour des utilisations psychiatriques. Néanmoins, ces machines servent jusqu’ici à recueillir des données ou à éclairer le personnel soignant dans la prise de décisions. En effet, ces technologies connaissent encore plusieurs limites, malgré leur potentiel indéniable. Ainsi, la question de savoir si elles surpasseraient un jour les compétences d’un vrai psy a bien lieu d’être. Pour y répondre, il est important de revenir sur la fonction du médecin psychiatre.

Dans cet article :

Qu’est-ce qu’un médecin psychiatre ?

Au même titre qu’un cardiologue ou un chirurgien, le psychiatre est un médecin spécialiste. Il est en mesure de diagnostiquer des patients et de proscrire des traitements après avoir suivi une formation complète. Ce cursus comprend une formation médicale générale et une formation spécialisée dans les maladies mentales d’environ 6 ans.

Pour poser son diagnostic, le psychiatre peut réaliser un examen mental et physique, des analyses de laboratoire, de l’imagerie médicale et étudier une histoire psychosociale détaillée. Ensuite, il peut recourir à différents moyens combinables pour traiter les patients. Il s’agit notamment de : psychothérapies, d’un éventail de médicaments, des techniques de neurostimulation et des interventions sociales.

De plus en plus de robots thérapeutes après la Covid-19

L’idée d’intégrer l’intelligence artificielle à cette panoplie d’outils mis à la disposition du psychiatre est apparue en 1966. En effet, c’était l’année où Joseph Weizenbaum a terminé le codage de son chatbot (programme de dialogue), nommé ELIZA. Dédiée à la psychiatrie, l’IA simule un psychothérapeute rogérien (approche centrée sur la personne) en reformulant la plupart des affirmations du « patient » en questions, pour ensuite les lui poser.

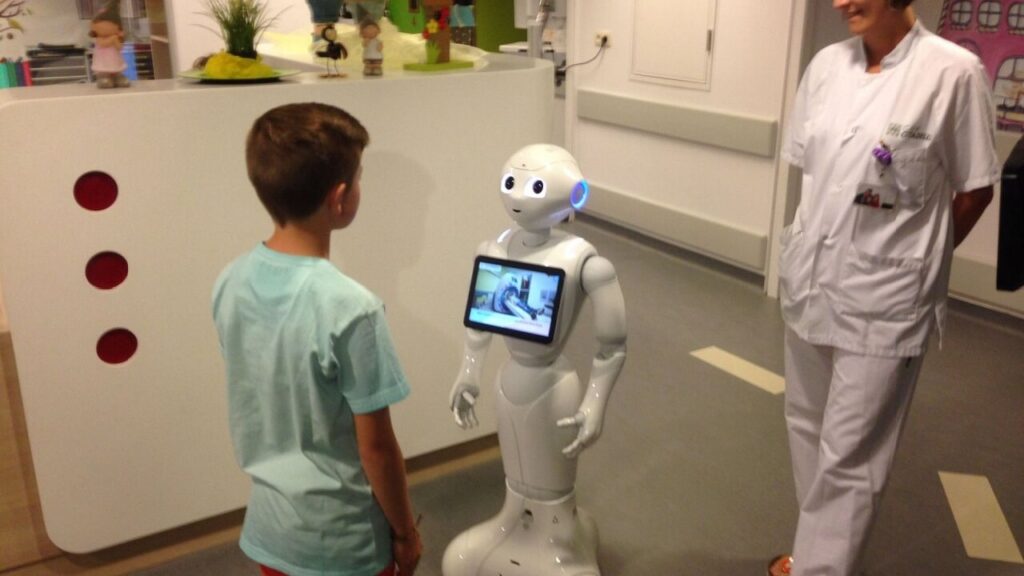

Le concept a ressurgi ces dernières décennies, notamment avec le contexte de la crise sanitaire. De plus en plus de « robots-thérapeutes » et de systèmes de détection de l’état de santé à travers la voix ont vu le jour. Certains chercheurs pensent que les patients pourraient avoir plus d’affinité avec les robots que les médecins. Ils seraient ainsi susceptibles de développer de véritables relations thérapeutiques avec ces machines.

L’illusion d’un psychiatre virtuel objectif

Théoriquement, en plus d’être neutres et dénués de tout jugement, les psys numériques auraient plusieurs autres avantages. Le fait qu’ils n’ont pas d’émotions les permettrait de prendre des décisions objectives, réplicables et neutres. De plus, contrairement à leurs homologues humains, ils ne risquent pas de faire des erreurs à cause de la fatigue ou d’être indisponibles.

Néanmoins, il ne faut pas oublier que les machines sont codées par des ingénieurs. Pour collecter les données et entrainer les intelligences artificielles, ces derniers se basent sur leurs modèles internes. Dans bien des cas, les IA ont été accusées de discrimination ou de subjectivité à cause des informations avec lesquelles elles ont été alimentées. Ses processus de traitement et ses décisions dépendront aussi de la subjectivité du codeur lui-même et de ses choix techniques. En effet, son expérience, la qualité de sa formation, son salaire ou le temps de travail pour écrire son code peuvent influencer la machine.

Pas plus que le psychiatre humain ?

Pour l’heure, l’intelligence artificielle n’est pas tout à fait exempte de subjectivité… En tout cas, pas plus que son homologue humain. Dans leur mode opératoire, le médecin psychiatre et l’algorithme ne sont pas totalement différents.

Le recueil des données et leur traitement

Le psychiatre et l’intelligence artificielle fonctionnent plus ou moins de la même manière durant un entretien psychiatrique. Ils recueillent d’abord les données de manière exhaustive et relativement aléatoire. Pour ce faire, ils se basent sur le dossier médical, les gestes et les réactions du patient, etc. Ensuite, ils les sélectionnent et les traitent en fonction de celles qu’ils estiment pertinentes ou insignifiantes. C’est en les organisant ainsi que le psy, tout comme la machine, les associe à des profils préexistants, ayant des traits communs, et pose le diagnostic.

La construction du modèle

Chaque médecin psychiatre développe ce qu’on appelle « modèle interne ». Il s’agit d’un ensemble de processus mentaux, explicites ou implicites, qui lui permettent de poser son diagnostic. C’est à partir de ce modèle interne qu’il formule l’issue diagnostique. Il le construit tout au long de sa formation et au cours de sa carrière, notamment à travers ses expériences cliniques, la lecture de rapports de cas, etc. Ce modèle s’aiguise et se renforce au fur et à mesure qu’il pratique. Pareillement, l’algorithme développe son propre modèle interne au cours de son entrainement initial et de son apprentissage. Notons par contre que la machine a ici l’avantage de pouvoir traiter bien plus de cas qu’un médecin psychiatre n’en pourra jamais.

L’utilisation du modèle

Le modèle interne est important, car c’est à partir de sa connaissance de l’issue diagnostique que le psy ou la machine prendra les décisions. Le médecin ou l’IA s’y réfèrera pour traiter de nouveaux patients. Mais d’autres facteurs entreront certainement en jeu pour l’humain, tels que son salaire ou sa charge de travail. De même, le coût du matériel et le temps nécessaire à l’entraînement ou l’utilisation sont à considérer pour l’intelligence artificielle.

Le psy humain est-il donc plus fiable que la machine ?

Doué d’empathie, le médecin psychiatre serait plus apte à détecter les gestes qui trahissent les patients dans leurs discours. Cette faculté est d’autant plus importante dans ces cas des suicidaires ou des victimes de violences conjugales, par exemple. Il serait également plus à même d’identifier les réels problèmes du patient et d’accéder à des informations de temporalité très différentes. En effet, il est plus souple que l’IA, dans le sens où il peut reconduire l’échange en temps réel en fonction des réponses obtenues.

Le manque de corporéité constitue également un important facteur limitant de l’IA en psychiatrie. Cet élément est pourtant crucial dans la prise en charge et le traitement des maladies mentales. L’entretien clinique est notamment caractérisé par le dialogue médecin-patient. La parole et la communication non verbale y sont essentielles.

Pour l’heure, le médecin psychiatre semble définitivement plus fiable pour prendre en charge et traiter les maladies mentales. Les Intelligences Artificielles servent néanmoins de précieux outils qui aident à accélérer le recueil des données, l’établissement du diagnostic et la qualité du traitement.

VOIR AUSSI : Top 10 des choses que l’Intelligence Artificielle fait mieux que les humains

Faut-il donc oublier le concept de psy virtuel ?

Comme dans la plupart des projets IA dans d’autres secteurs, les prouesses dernièrement enregistrées n’excluent pas les facteurs limitants. Jusqu’ici, l’intelligence artificielle reste un outil plutôt qu’un substituant d’une fonction occupée par l’humain. Mais personne ne sait ce que réserve l’avenir étant donné que l’IA que nous connaissons aujourd’hui est dite « faible ». Ainsi, personne ne sait encore ce que réservent les prochaines avancées en la matière.

Julia : la psy virtuelle capable de diagnostiquer des troubles dépressifs sévères

Plus tôt dans le mois, l’équipe du laboratoire Sanpsy a annoncé avoir conçu une psy virtuelle révolutionnaire. Selon leur description, il s’agit du premier humain virtuel capable de conduire un entretien psychiatrique pour diagnostiquer des troubles de la dépression. Leurs travaux ont été documentés dans la revue Sientific Reports.

L’IA s’appelle Julia. Elle a un visage et une voix assez conventionnels. Pour plus de réalisme, elle a été entraînée pour faire des gestes et mimiques en fonction de la conversation. Pour ce faire, les ingénieurs ont utilisé la technique de capture de mouvements (motion capture).

« L’entretien entre cet humain virtuel et le patient est construit à partir d’un référentiel médical validé (ndlr : basé sur le DSM-5, le manuel diagnostique et statistique des troubles mentaux créé par l’Association Américaine de Psychiatrie), enrichi par des tournures de phrases et des interactions gestuelles et faciales renforçant l’engagement du patient dans l’échange. »

Pierre Philip, praticien hospitalier au CHU de Bordeaux et directeur de l’unité Sanpsy (sommeil – addiction – neuropsychiatrie) au CNRS

Pierre et son équipe ont constaté que la performance de cette IA augmente en fonction de la sévérité des symptômes dépressifs. Les résultats qu’elle a affichés jusqu’ici sont ainsi prometteurs. Néanmoins, ils n’égalisent pas encore ceux d’un vrai médecin. Ce dernier serait plus fiable pour diagnostiquer à partir de légers symptômes.

« L’enjeu n’est pas de remplacer le médecin, mais d’assister ce dernier pour diagnostiquer plus rapidement des patients non identifiés comme dépressifs et possiblement, dans le futur, d’assurer un suivi médical de qualité au domicile du patient. »

D’après ses concepteurs, Julia a été conçue pour assurer un suivi médical de qualité au domicile du patient. Jusqu’ici, l’algorithme a enregistré « un score d’acceptabilité de 25,4/30 de la part des patients ».

Une IA qui fait mieux que plusieurs radiologues humains

En 2020, une étude impliquant 25 000 patients aux États-Unis et au Royaume-Uni a été menée pour tester une IA sur le cancer du sein. Scott McKinney, de Google Health à Palo Alto, en Californie, et ses collègues ont évalué un algorithme de deep learning sur sa capacité à reconnaître le cancer du sein sur les mammographies.

Dans cette étude, la machine n’avait aucune idée préétablie de ce qu’est un cancer du sein. Elle s’est uniquement référée à des millions d’itérations pour répéter les images. Finalement, elle a largement dépassé les performances de plusieurs radiologues humains.

“Dans cette étude, l’IA était tout simplement meilleure pour accomplir cette tâche que les comparateurs humains, et je pense que cela montre vraiment quelle est déjà la puissance de cette technologie. Et en gardant à l’esprit ce processus d’autoamélioration continue et continue par lequel ces algorithmes passent, vous pouvez projeter dans 10 ans … où nous pourrions penser que ces algorithmes du cancer du sein seront. Je pense donc que cela définit vraiment l’étape pour commencer à chercher plus spécifiquement dans les cas qui pourrait avoir plus de pertinence pour la psychiatrie.”

Richard Cockerill, MD, professeur adjoint de psychiatrie à la Northwestern University Feinberg School of Medicine à Chicago

BuzzWebzine est un média indépendant. Soutiens-nous en nous ajoutant à tes favoris sur Google Actualités :